Le didascalie delle foto generate dall’intelligenza artificiale su Facebook e Instagram ora forniscono maggiori dettagli: TechCrunch

Ogni immagine pubblicata su Facebook e Instagram riceve didascalie generate dall’analisi dell’immagine AI, l’AI è più intelligente. Il sistema migliorato Dovrebbe essere un piacere per gli utenti ipovedenti e potrebbe aiutarti a trovare le tue foto più velocemente in futuro.

Un testo alternativo è un campo nei metadati dell’immagine che ne descrive il contenuto: “Una persona in piedi in un campo con un cavallo” o “Un cane su una barca”. Ciò consente alle persone di capire l’immagine che non possono vederla.

Spesso queste descrizioni vengono aggiunte manualmente dal fotografo o dal post, ma le persone che caricano le foto sui social media generalmente non si preoccupano, se hanno la possibilità. Quindi la capacità relativamente recente di generarne uno automaticamente – la tecnologia è diventata abbastanza buona negli ultimi due anni – è stata molto utile per rendere i social media più accessibili in generale.

Facebook ha creato il sistema di testo alternativo automatico nel 2016, che è stato per eoni nel campo dell’apprendimento automatico. Da allora il team ha apportato diversi miglioramenti, rendendolo più veloce e più dettagliato e un recente aggiornamento aggiunge un’opzione per creare una descrizione più dettagliata su richiesta.

Il sistema migliorato riconosce dieci volte più elementi e concetti rispetto all’inizio e ora circa 1.200. Le descrizioni includono più dettagli. Quello che era “Due persone accanto a un edificio” potrebbe ora essere un “Autoritratto di due persone accanto alla Torre Eiffel”. (Copri le descrizioni effettive con “Potrebbe essere …” ed eviterai di includere ipotesi selvagge.)

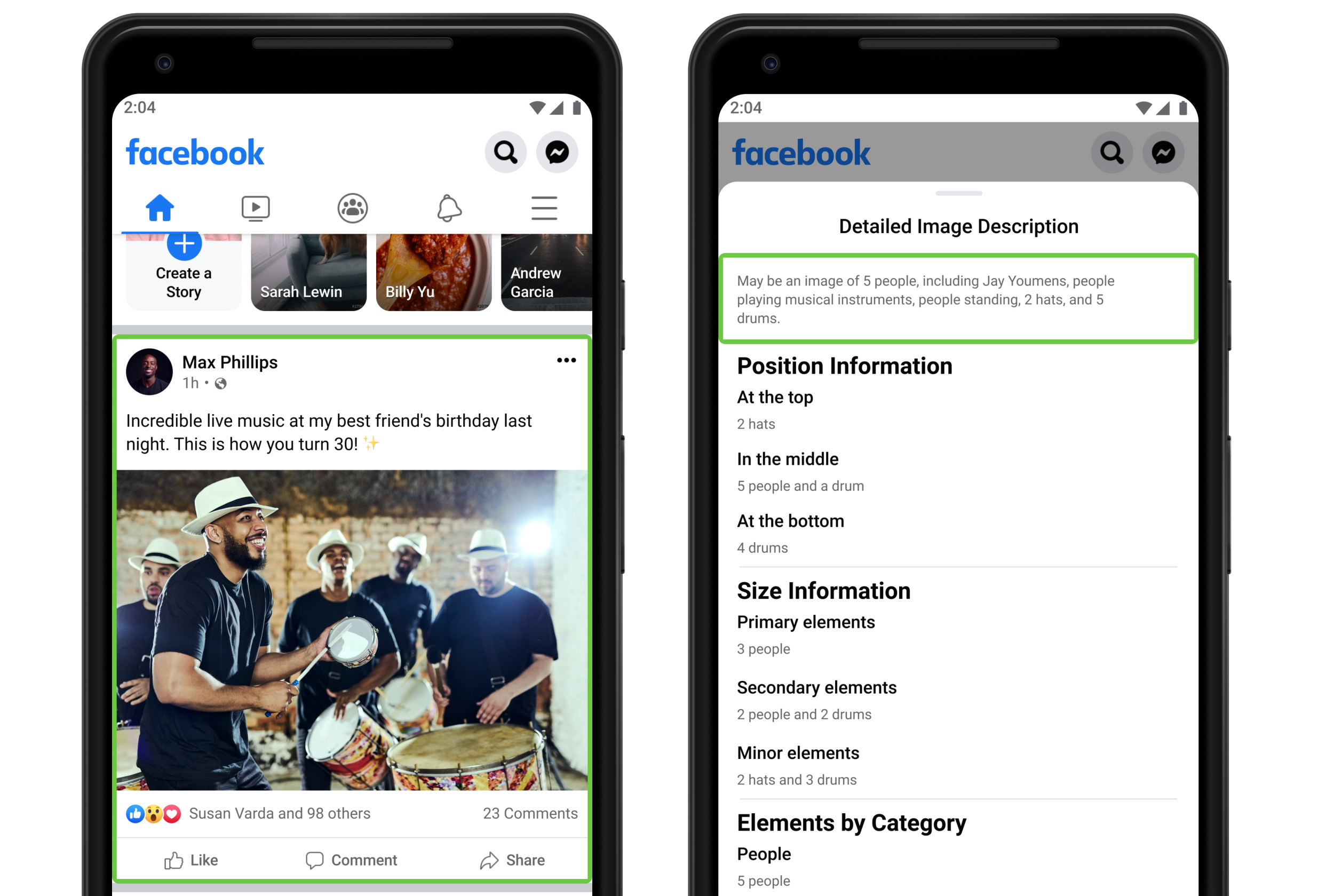

Ma ci sono più dettagli di questo, anche se non sono sempre rilevanti. Ad esempio, in questa immagine, l’IA osserva le posizioni relative di persone e cose:

Le persone sono chiaramente al di sopra della batteria, i cappelli sono sopra le persone e niente di tutto ciò ha bisogno di essere detto di qualcuno per capire il loro succo. Ma considera un’immagine descritta come “una casa, alcuni alberi e una montagna”. La casa è in montagna o di fronte? Gli alberi sono davanti o dietro la casa, o forse sulla montagna in lontananza?

Per descrivere adeguatamente l’immagine, questi dettagli devono essere compilati, anche se l’idea generale può essere attraversata con meno parole. Se una persona vedente desidera maggiori dettagli, può guardare da vicino o fare clic sull’immagine per una versione più grande: la persona che non può farlo ora ha un’opzione simile con il comando “Crea descrizione dettagliata dell’immagine”. (Attivalo con una pressione prolungata nell’app Android o un’azione personalizzata in iOS.)

La nuova descrizione potrebbe essere qualcosa del tipo “Una casa e alcuni alberi davanti a una montagna sulla neve”. Questo dipinge un’immagine migliore, giusto? (Per essere chiari, questi esempi sono stati inventati, ma sono il tipo di miglioramento previsto.)

La nuova funzione di descrizione dei dettagli di Facebook verrà prima testata, anche se presto su Instagram apparirà un vocabolario migliorato. Le descrizioni sono anche mantenute semplici in modo che possano essere facilmente tradotte in altre lingue già supportate dalle applicazioni, sebbene la funzionalità non possa essere implementata contemporaneamente in altri paesi.

“Comunicatore. Ninja web hardcore. Amante estremo dei social media. Analista. Drogato di alcol.”